به گزارش ساوت چاینا مورنینگ پست، چینیها ذاتاً نسبت به پیشنهادهای آمریکا برای کاهش ریسک بدبین هستند. روسیه نیز با زبان مشابهی در نهادهای چندجانبه مخالفت کرده بود. از آنجا که گفتوگوهای دوجانبه با آمریکا درباره هوش مصنوعی و امنیت هستهای میتوانست شکافی میان روسیه و چین ایجاد کند، پیشرفت در این زمینه از پیش تضمینشده نبود.

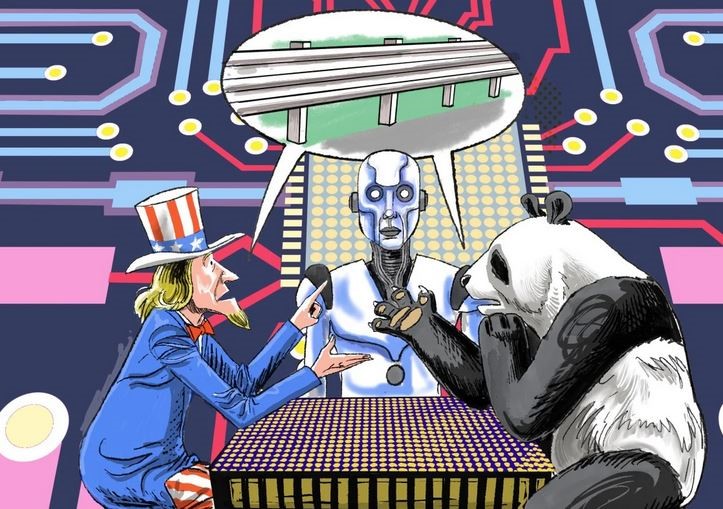

در نهایت، نتیجه بهدستآمده مهم بود، زیرا نشان داد که دو ابرقدرت هوش مصنوعی میتوانند حتی در حالی که بهشدت برای رهبری در حوزه هوش مصنوعی رقابت میکنند، در زمینه مدیریت سازنده ریسکها با یکدیگر تعامل داشته باشند.

علاوه بر این، دیپلماتها و کارشناسان دو کشور پیشتر در سال ۲۰۲۴ در ژنو برای نشستی طولانیمدت که بهطور اختصاصی به ریسکهای هوش مصنوعی اختصاص داشت، گرد هم آمده بودند. هرچند این نشست به نتایج قابلتوجهی منجر نشد، اما نفس برگزاری آن گامی مهم بود.

اکنون، با شتاب گرفتن روند توسعه و بهکارگیری هوش مصنوعی، هم در حوزههای غیرنظامی و هم نظامی ایالات متحده و چین باید بر پایه این بنیان حرکت کنند و دیپلماسی پایدار و سطحبالا درباره ریسکهای هوش مصنوعی را دنبال کنند، حتی در حالی که هر یک برای پیشتازی در رقابت هوش مصنوعی تلاش میکند.

با پیشرفت و گسترش قابلیتهای هوش مصنوعی، بازیگران غیردولتی میتوانند از آن برای تهدید هم ایالات متحده و هم چین استفاده کنند. چنین تهدیدهایی میتواند اشکال گوناگونی داشته باشد، از جمله حملات سایبری، سلاحهای زیستی نوظهور، کارزارهای اطلاعات نادرست و پهپادهای مرگبار مجهز به هوش مصنوعی که قادرند در هر مکانی حمله کنند.

ریسکها به اینجا ختم نمیشود. با افزایش استفاده ارتشهای آمریکا و چین از هوش مصنوعی که چرخههای تصمیمگیری را کوتاهتر میکند، خطر آنکه سامانههای مبتنی بر هوش مصنوعی بهطور ناخواسته موجب آغاز یک درگیری یا تشدید فاجعهبار تنش شوند، افزایش خواهد یافت. با تبدیل شدن هوش مصنوعی به عنصری هرچه مرکزیتر در نظام بانکی جهانی، معاملات مبتنی بر هوش مصنوعی میتواند موجب سقوط بازارها شود.

و اگر جلوتر را نگاه کنیم، میتوان تصور کرد که یک سامانه هوش مصنوعی قدرتمند اما ناهمسو تهدیدی جدی برای بشریت ایجاد کند. ایالات متحده و چین، بهعنوان تنها ابرقدرتهای هوش مصنوعی جهان، باید مستقیماً با یکدیگر وارد تعامل شوند تا به این خطرات و سایر تهدیدها رسیدگی کنند.

تعامل به این معنا نیست که چین و آمریکا رقابت را متوقف خواهند کرد که رقابت برای رهبری در کاربردهای نظامی، اطلاعاتی و تجاری، و همچنین در پذیرش مدلها و کاربردهای هوش مصنوعی آمریکایی و چینی توسط کشورهای سراسر جهان، تنها شدیدتر خواهد شد.

اما دقیقاً به دلیل همین رقابت شدید است که دیپلماسی ضروری است. کاملاً غیرمسئولانه خواهد بود اگر ایالات متحده و چین بدون تعامل با یکدیگر درباره ریسکها، یا بدون گفتوگو درباره فرصتهای عظیمی که هوش مصنوعی برای مقابله با چالشهای فراملی از بحران اقلیمی گرفته تا سلامت عمومی فراهم میکند، شتابزده پیش بروند.

بیتردید، متفکران برجستهای در تلاشهای دیپلماتیک موسوم به «مسیر دوم» مشارکت داشتهاند. این گفتوگوها ارزشمند هستند و باید ادامه یابند. اما در نهایت، هیچ جایگزینی برای تعامل مستقیم دولت با دولت وجود ندارد.

همچنین، با توجه به سرعت خیرهکننده پیشرفت فناوری و دشواریهای قابل پیشبینی در دستیابی به دستاوردهای دیپلماتیک، تعامل را نمیتوان به تعویق انداخت. مدیریت ریسکهای هوش مصنوعی قلمرویی ناشناخته است و پیشرفت در آن نه سریع خواهد بود و نه آسان.

بسیاری از ناظران شباهتهایی میان این وضعیت و کنترل تسلیحات هستهای ترسیم کردهاند و این قیاس تا حدی درست است. ابرقدرتها مسئول مدیریت ریسکهای ناشی از فناوریهای قدرتمند هستند و در گذشته از طریق توافقهای کنترل تسلیحات این مسئولیت با موفقیت انجام شده است. اما هوش مصنوعی چالشهای متفاوتی را مطرح میکند که به رویکردهای نوآورانهتری نیاز دارد.

نخست، راستیآزمایی دشوارتر است. شمارش موشکها و کلاهکها با نشانههای قابل شناسایی یک موضوع است؛ شمارش الگوریتمها موضوعی کاملاً متفاوت است.

دوم، مسئله کاربری دوگانه به شکلی متفاوت مطرح میشود. میان انرژی هستهای صلحآمیز و سلاحهای هستهای مرز نسبتاً روشنی وجود دارد. در مقابل، همان مدل هوش مصنوعی که میتواند به پیشرفت پژوهشهای علمی و ایجاد رشد اقتصادی کمک کند، میتواند به ایجاد آثار مرگبار نیز یاری برساند.

سوم، گفتوگوهای کنترل تسلیحات عمدتاً بر تهدید دولتها علیه دولتها متمرکز بودهاند. ریسکهای هوش مصنوعی شامل تهدیدهای دولتبهدولت، تهدیدهای غیردولتی و ریسکهای ناشی از ناهمسویی هوش مصنوعی است. این امر چالشها و فرصتهای متفاوتی برای دیپلماسی ایجاد میکند.

چهارم، دستکم در ایالات متحده، توسعه هوش مصنوعی نه توسط دولت بلکه توسط بخش خصوصی انجام میشود و نه توسط یک شرکت، بلکه توسط بسیاری از شرکتهایی که با یکدیگر رقابت میکنند. این بدان معناست که دامنه گستردهتری از بازیگران باید در گفتوگوها مشارکت داشته باشند.

در نهایت، دیدگاههای بسیار متنوعی درباره سرعت و میزان پیشرفت قابلیتهای هوش مصنوعی وجود دارد. برخی آن را فناوری «عادی» میدانند که پذیرش کامل آن دههها طول خواهد کشید، در حالی که برخی دیگر معتقدند انفجار ابرهوش تنها چند سال فاصله دارد. در مورد سلاحهای هستهای، تقریباً میدانستید با چه چیزی روبهرو هستید. مسیر تکامل قابلیتهای هوش مصنوعی بسیار نامشخصتر است.

چارچوب کنترل تسلیحات هستهای یکشبه شکل نگرفت. سالها زمان برد تا کنترلها، پروتکلها و حفاظهای لازم طراحی شود و دههها دیپلماسی برای حفظ آنها صرف شد. در مورد هوش مصنوعی، در مراحل آغازین چیزی مشابه از نظر میزان جاهطلبی، اما متفاوت از نظر ماهیت و پیچیدگی قرار داریم. همین موضوع ضرورت آغاز فوری تلاشها برای کاهش ریسک را دوچندان میکند.

*نویسنده: جیک سالیوان، مشاور امنیت ملی جو بایدن

منبع: scmp